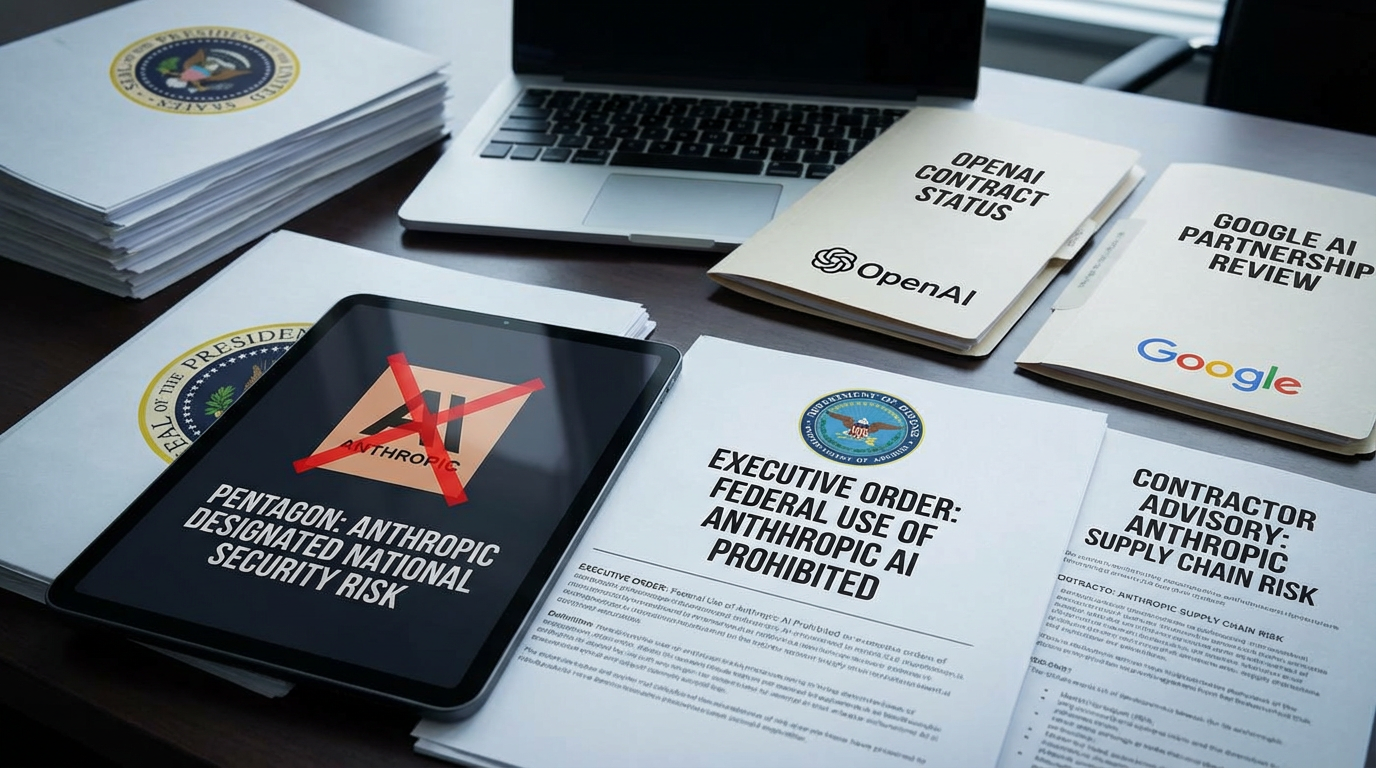

הפנטגון מגדיר את Anthropic כסיכון לביטחון לאומי

נשיא ארה"ב הורה על הפסקת שימוש פדרלי במוצרי Anthropic בעקבות סירובה לאפשר שימוש במודלי הבינה המלאכותית שלה למעקב המוני ונשק אוטונומי מלא. שר ההגנה הכריז על החברה כסיכון לשרשרת האספקה, ואסר על כל קבלן צבאי לעבוד איתה. OpenAI ו-Google, שגם זכו בחוזים דומים, מתמודדים כעת עם דילמה דומה.

משבר חסר תקדים בענף הבינה המלאכותית

לאחר שדיווחנו אתמול בכתבה על התקרבות הדד-ליין שניתן לחברת Anthropic https://ziratai.org/news/-anthropic-ai (לצפייה בכתבה יש ללחוץ על הקישור)

רוצה להישאר מעודכן ב-AI?

הירשם לדיוור השבועי שלנו וקבל עדכונים, המלצות על כלים, חדשות ודוחות מיוחדים

בצעד חריג ונדיר הפנטגון הכריז על Anthropic כסיכון לשרשרת האספקה של הביטחון הלאומי האמריקאי. ההחלטה הגיעה לאחר שהחברה סירבה להתפשר על שני עקרונות מרכזיים: איסור שימוש במודלי הבינה המלאכותית של למעקב המוני מקומי ולנשק התקפי אוטונומי לחלוטין.

נשיא ארצות הברית פרסם הודעה ברשת החברתית Truth Social בה הורה לכל הסוכנויות הפדרליות להפסיק את השימוש במוצרי Anthropic תוך שישה חודשים. "אנחנו לא צריכים את זה, לא רוצים את זה, ולא נעשה איתם עסקים שוב", כתב הנשיא בפוסט.

שר ההגנה פיט הגסת' הלך צעד נוסף והכריז רשמית על Anthropic כסיכון לשרשרת האספקה הביטחונית. ההחלטה אוסרת על כל קבלן, ספק או שותף העובד עם הצבא האמריקאי לנהל כל פעילות מסחרית עם Anthropic - צעד שעלול לפגוע קשות ביכולת החברה לפעול בשוק.

עמידה בעקרונות מול לחץ ממשלתי

המחלוקת התחילה כאשר Anthropic סירבה לאפשר שימוש במודלי Claude שלה לצרכים שהחברה מגדירה כבעייתיים מבחינה אתית. המנכ"ל דריו אמודיי הבהיר בהצהרה פומבית ביום חמישי כי החברה לא תתפשר על שני העקרונות האלה, למרות הלחץ הממשלתי.

"העדפתנו החזקה היא להמשיך לשרת את המחלקה ואת הלוחמים שלנו - עם שני אמצעי ההגנה שביקשנו", כתב אמודיי. "אם המחלקה תבחר להפסיק את Anthropic, נעבוד כדי לאפשר מעבר חלק לספק אחר, תוך הימנעות מכל הפרעה לתכנון צבאי, מבצעים או משימות קריטיות אחרות".

תמיכה בענף והשלכות על המתחרים

OpenAI הצטרפה לתמיכה בעמדת Anthropic בצורה מפתיעה. המנכ"ל סם אלטמן שלח מזכר לעובדים ביום חמישי בו הצהיר שהוא חולק את אותם "קווים אדומים", וכי כל חוזה הגנה הקשור ל-OpenAI ידחה שימושים "לא חוקיים או לא מתאימים לפריסות ענן, כמו מעקב מקומי ונשק התקפי אוטונומי" (כפי שדווח ב-BBC).

איליה סוצקבר, מייסד משותף של OpenAI שהקים חברת AI משלו לאחר פרידה סוערת מאלטמן, גם הוא הצטרף לשיח. "זה טוב מאוד ש-Anthropic לא נסוגה, וזה משמעותי ש-OpenAI נקטה עמדה דומה", כתב ב-X ביום שישי. "בעתיד יהיו מצבים מאתגרים הרבה יותר מסוג זה, ויהיה קריטי שהמנהיגים הרלוונטיים יעמדו באתגר".

Google, שגם זכתה בחוזה עם משרד ההגנה ביולי 2025 יחד עם Anthropic ו-OpenAI, טרם הגיבה באופן רשמי. עם זאת, עובדי Google DeepMind פרסמו מכתב תמיכה ב-Anthropic (כפי שדווח ב-New York Times).

השלכות על השוק הישראלי

המשבר מעלה שאלות משמעותיות עבור חברות ישראליות העובדות עם Anthropic או שוקלות שיתוף פעולה עם החברה. יחידות טכנולוגיה בצה"ל וחברות סייבר ישראליות שעבדו עם מודלי Claude עשויות להידרש למצוא חלופות. מנגד, העמדה העקרונית של Anthropic עשויה לחזק את מעמדה בקרב ארגונים ישראליים המחפשים פתרונות AI אתיים ומבוקרים.

חברות ישראליות המתמחות בפיתוח מודלים חלופיים או בשכבות בטיחות ל-AI עשויות למצוא הזדמנויות חדשות בעקבות הפער שנוצר. השאלה האמיתית היא האם חברות בינה מלאכותית נוספות יצטרכו לבחור בין שוק ההגנה האמריקאי לבין עקרונות אתיים - ואיך בחירה זו תשפיע על הנוף התחרותי העולמי.