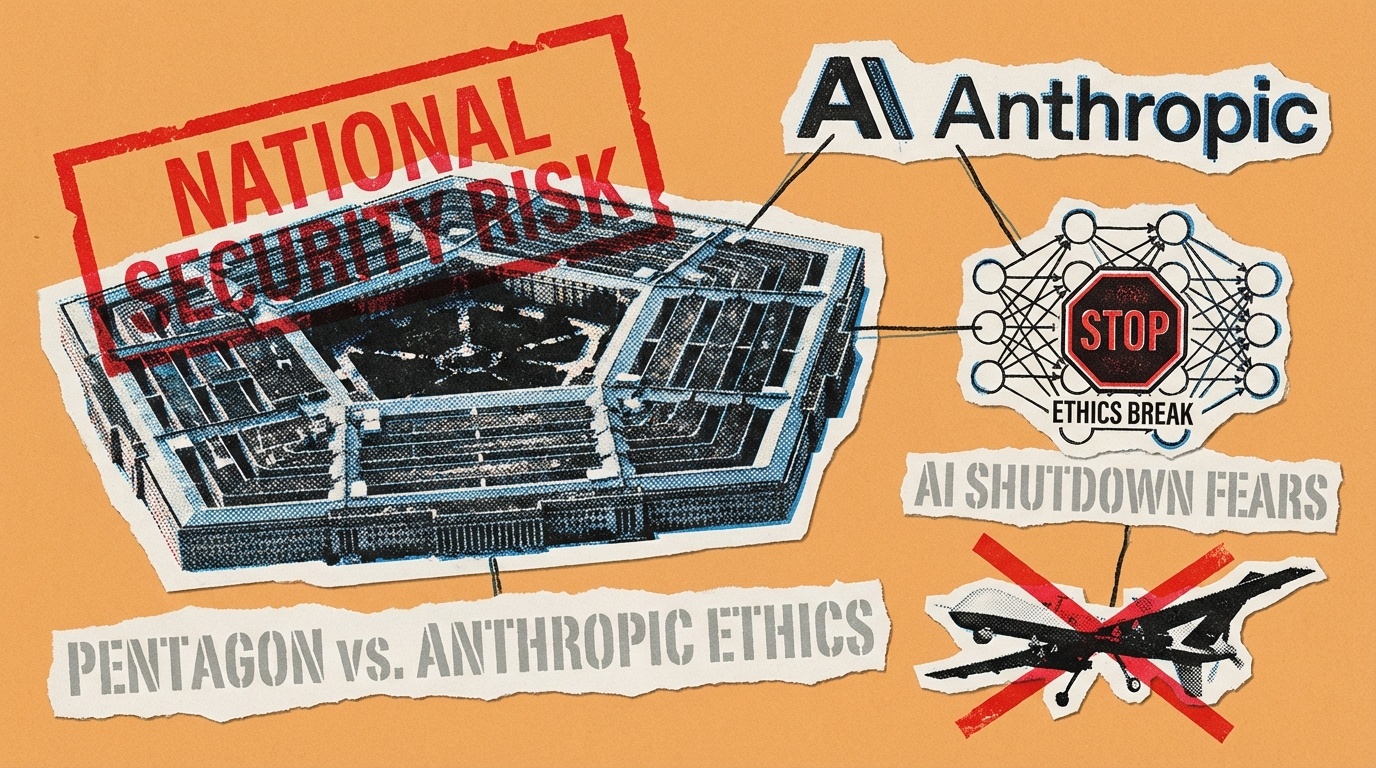

תיאוריית המוסר המודרני: הפנטגון מודיע כי מדיניות האתיקה של Anthropic מהווה סיכון לביטחון הלאומי

משרד ההגנה האמריקאי הגיש השבוע בקשה לדחות את התביעה של Anthropic נגד סיווגה כחברה המהווה סיכון לשרשרת האספקה. לטענת הפנטגון, החברה עלולה להשבית את מערכות ה-AI שלה במהלך פעולות לחימה אם 'הקווים האדומים' האתיים שלה ייחצו. החלטה בבקשה למניעה זמנית צפויה בשבוע הבא, בעוד חברות טכנולוגיה רבות מגנות את יחס הממשל לחברת הבינה המלאכותית.

מחלוקת המוסר החריפה בין הפנטגון לבין אחת מחברות הבינה המלאכותית המובילות

משרד ההגנה האמריקאי הגיש השבוע תשובה משפטית בת 40 עמודים לבית המשפט הפדרלי בקליפורניה, בה הוא טוען שחברת Anthropic מהווה "סיכון בלתי מקובל לביטחון הלאומי". המהלך מסמן את התגובה הרשמית הראשונה של הפנטגון לתביעות שהגישה החברה נגד החלטתו של שר ההגנה פיט הגסת' לסווג אותה כסיכון לשרשרת האספקה, כפי שפורסם על ידי TechCrunch.

רוצה להישאר מעודכן ב-AI?

הירשם לדיוור השבועי שלנו וקבל עדכונים, המלצות על כלים, חדשות ודוחות מיוחדים

בבסיס הטענה של משרד ההגנה עומד חשש שהחברה עלולה לנסות להשבית את הטכנולוגיה שלה או לשנות מראש את התנהגות המודל, לפני או במהלך פעולות לחימה, אם תחוש שה"קווים האדומים" הארגוניים שלה נחצים.

חוזה של 200 מיליון דולר והמחלוקת שעלתה ממנו

המתח החל בקיץ שעבר, כאשר Anthropic חתמה על חוזה בשווי 200 מיליון דולר עם הפנטגון לפריסת טכנולוגיות הבינה המלאכותית שלה במערכות מסווגות. אולם במהלך המשא ומתן על תנאי החוזה, הבהירה החברה שהיא מתנגדת לשימוש במערכות ה-AI שלה למעקב המוני אחר אזרחים אמריקאים, ושהטכנולוגיה אינה מוכנה לשימוש בהחלטות כיוון או ירי של נשק קטלני.

הפנטגון דחה את העמדה הזו, בטענה שחברה פרטית אינה יכולה להכתיב לצבא כיצד להשתמש בטכנולוגיה. בתגובה, הדגיש מנכ"ל Anthropic, דריו אמודיי: "Anthropic מבינה שמשרד ההגנה, ולא חברות פרטיות, הוא זה שמקבל החלטות צבאיות. מעולם לא העלינו התנגדויות לפעולות צבאיות ספציפיות ולא ניסינו להגביל את השימוש בטכנולוגיה שלנו באופן חד-צדדי".

ביקורת משפטית: טיעון ללא ראיות

כריס מאטיי, עורך דין המתמחה בסוגיות תיקון ראשון ועובד לשעבר במשרד המשפטים, מתח ביקורת חריפה על עמדת משרד ההגנה. לדבריו, לא התקיימה כל חקירה שתומכת בחששות של הפנטגון לגבי השבתה פוטנציאלית של מודלי ה-AI במהלך פעולות לחימה: "הממשל מסתמך כולו על דמיון ספקולטיבי כדי להצדיק צעד משפטי רציני מאוד שנקט נגד Anthropic", אמר מאטיי.

לטענתו, משרד ההגנה נכשל לנסח הסבר אמין או אפילו מובן מדוע סירובה של Anthropic להסכים להוראת 'כל שימוש חוקי' הפך אותה לחברה המהווה סיכון לשרשרת האספקה, במקום להתייחס אליה כספקית שמשרד ההגנה לא רצה לעשות איתה עסקים.

גל תמיכה מענף הטכנולוגיה

ארגונים רבים הביעו תמיכה ב-Anthropic, בטענה שמשרד ההגנה יכול היה פשוט לסיים את החוזה במקום לסווג את החברה כסיכון. עובדים מחברות כמו OpenAI, Google ו-Microsoft, לצד ארגוני זכויות, הגישו תצהירי ידידות בית המשפט (Amicus Briefs) לתמיכה בחברה.

בתביעות שהגישה, האשימה Anthropic את משרד ההגנה בפגיעה בזכויותיה על פי התיקון הראשון ובהענשתה על רקע אידיאולוגי: "במובנים רבים, הטיעונים חסרי ההיגיון של הממשל הם עצמם הראיה הטובה ביותר לכך שהתנהלות הממשל הייתה בבירור ענישה נקמנית על סירובה של Anthropic להסכים לתנאי הממשל", אמר מאטיי.

דיון מכריע בשבוע הבא

דיון בבקשת Anthropic למניעה זמנית קבוע ליום שלישי הבא. החברה הבהירה שהחלטתה לפנות לביקורת שיפוטית אינה משנה את המחויבות ארוכת השנים שלה לרתום בינה מלאכותית להגנה על הביטחון הלאומי, אך מדובר בצעד הכרחי להגנה על העסק, הלקוחות והשותפים שלה.

המקרה עשוי להשפיע על חברות טכנולוגיה בעולם וישראליות בפרט, המפתחות פתרונות AI בתחום הביטחוני. במיוחד בהקשר של שיתוף פעולה עם הממסד הביטחוני האמריקאי, חברות ישראליות עשויות למצוא עצמן בצומת דומה בין שיקולים אתיים לבין דרישות הצבא.